富士通研、ビッグデータのディスク読み書きを約1/10に削減する技術を開発

エンタープライズ

ソフトウェア・サービス

-

10G光回線導入レポ

-

爆発的に増加するM2Mデータを分散処理……データ量を100分の1に!富士通研究所が発表

-

NEC、SAP HANA向けアプライアンスサーバを販売開始……ストレージに「FlashMAX」採用

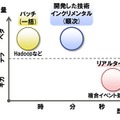

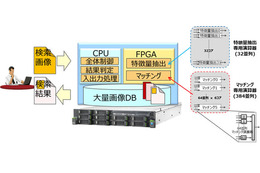

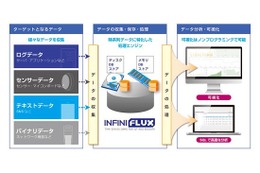

ビッグデータを処理する技術としては、大量データを分割して複数のサーバで高速に処理できる、Hadoopなどの「並列バッチ処理」が注目されている。一方、到着したデータをリアルタイムにメモリ上で処理する「複合イベント処理技術」などの技術も注目されている。

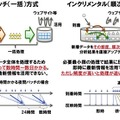

ディスクベースのデータ処理の方式では、バッチ(一括)方式とインクリメンタル(順次)方式があるが、バッチ方式では分析対象データをいったん蓄積してから一括的に処理するため、新しい情報が分析結果に反映され活用できるようになるまでに一定の時間差が生じるし、インクリメンタル方式ではディスクへのアクセスが多発するなど課題があった。

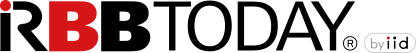

今回富士通研では、データの読み書きの傾向に合わせてディスクのデータを動的に再配置することで、ディスクへの読み書きを従来の約1/10に削減する「適応的データ局所化技術」を開発。インクリメンタル方式の並列分散データ処理ミドルウェアを実現した。これにより、従来、新しいデータを分析結果に反映するまでに数時間かかっていたものが数分で可能となる見込みだ。

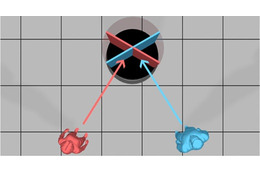

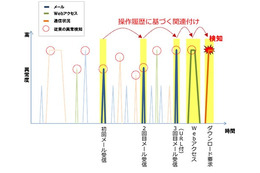

適応的データ局所化では、アクセス履歴を記録、最適な配置を計算、動的にデータを再配置というステップで処理を行う。これによって、多数のランダムアクセスではなく少数の連続アクセスのみで必要なデータを取得することが可能とのこと。今後、富士通研究所では、本技術のさらなる性能向上および実証実験を進め、2013年度中の実製品・サービスへの適用を目指す。