Ragate株式会社(以下、ラーゲイト)は、2025年12月に情報システム部門・DX推進室所属のビジネスパーソン505名を対象とした「生成AI活用における出力精度・ハルシネーション実態調査」を実施し、その結果をレポートとして公開しました。

本調査により、「出力精度の不確実性(ハルシネーション)」を課題と認識している企業が35.2%にのぼることが判明。セキュリティリスク(42.2%)に次ぐ第2位の重要課題として認識されており、約3社に1社が業務活用を妨げる深刻な問題と捉えています。また、ハルシネーション対策として最も有効なアプローチはRAG(検索拡張生成)の導入であり、DifyやAmazon Bedrockを活用したノーコードでの構築が現実的な解決策として注目されています。

調査レポート詳細はこちら

調査実施の背景

ハルシネーション対策ガイド

生成AIの業務活用が加速する一方で、「AIが自信満々に誤った情報を答えた」「根拠のない数値を事実のように提示された」--そうした経験を持つビジネスパーソンが急増しています。これがハルシネーション(幻覚:生成AIが事実に基づかない情報を正確であるかのように出力する現象)です。

ChatGPTをはじめとする大規模言語モデル(LLM)は、「もっともらしい文章を生成すること」を目的として設計されており、「正確な情報を出力すること」は本質的に保証されていません。学習データの限界、文脈理解の制約、最新情報への非対応--これらの特性が組み合わさり、業務判断の現場においてハルシネーションは看過できないリスクとなっています。

特に、意思決定の材料となる「情報収集・調査・分析」や、品質が問われる「システム開発・運用」といった領域での活用が拡大する中、誤情報に基づいた意思決定がビジネスに直接的な損失をもたらす可能性が現実のものとなっています。

ラーゲイトでは、こうした課題の実態を定量的に把握し、企業が実践できる具体的な対策手法を提示することを目的として、情報システム部門・DX推進室所属で選定・起案に関与する505名を対象に本調査を実施しました。

調査結果のハイライト

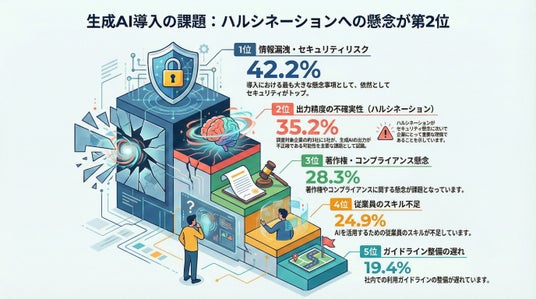

1. 35.2%がハルシネーションを課題と認識--セキュリティに次ぐ第2位

生成AI導入における課題を尋ねた設問では、以下の結果が得られました。

- 情報漏洩・セキュリティリスク:42.2%(1位)

- 出力精度の不確実性(ハルシネーション):35.2%(2位)

- 著作権・コンプライアンス懸念:28.3%(3位)

- 従業員のスキル不足:24.9%(4位)

- ガイドライン整備の遅れ:19.4%(5位)

約3社に1社がハルシネーションを重要課題として認識しており、単なる「使い方の問題」ではなく、組織レベルで対処が求められる経営課題として位置づけられていることが明らかになりました 。

2. 「情報収集・分析」39.2%が最高リスク領域--誤った意思決定が直接損失に直結

業務領域別に活用率とハルシネーションリスクを分析した結果、以下の傾向が判明しました。- 情報収集・調査・分析(活用率39.2%):リスク・影響度ともに「高」。誤った市場データや競合情報に基づく意思決定はビジネスへの直接的損害につながる最高リスク領域

- システム開発・運用(活用率37.4%):AIが生成したコードにバグや脆弱性が混入するリスクがあり、人間によるコードレビューが必須

- 議事録作成・要約(活用率28.1%):元の音声・文書が存在するため相対的にリスクは低いが、情報の取捨選択に偏りが生じる可能性あり

活用率の高い領域ほどハルシネーションの影響範囲が広がるという構造的課題が浮き彫りになりました。

3. 最も効果的な対策は「RAG導入」--Dify×Amazon Bedrockがノーコード実現を後押し

ハルシネーション低減に向けた対策のうち、最も根本的かつ効果的な手法はRAG(Retrieval-Augmented Generation:検索拡張生成)の導入です。社内ナレッジベースや信頼できる情報源と連携させることで、LLMの回答を事実に基づいたものへと制約できます。RAGに加えて有効な対策として以下が挙げられます。

- ファクトチェック体制の構築:AI出力→自動検証→人間レビュー→修正・承認という段階的プロセスの整備

- プロンプトエンジニアリングの最適化:「分からない場合は『分かりません』と回答してください」「不確かな部分には【要確認】と記載してください」など制約条件を明示

- 用途別のモデル選定:事実確認重視・コスト重視・日本語特化など用途に応じた最適モデルの使い分け

- 継続的なモニタリングと改善:ハルシネーション発生率・ファクトチェックでの修正率などKPIを設定し、改善サイクルを構築

ラーゲイトの考察と今後の展望

今回の調査結果が示す最も重要なメッセージは、「ハルシネーションはゼロにできないが、許容範囲内にコントロールすることは可能」という事実です。

35.2%という数字は単なる「不満の声」ではなく、AI活用の本格化とともに顕在化したガバナンス上の課題です。生成AIを業務に組み込む企業が増えるほど、出力品質の管理は「ITの問題」から「経営の問題」へと昇格します。特に、意思決定の材料として生成AIを活用する頻度が高い情報システム部門・DX推進室においては、品質管理の仕組みを先行して整備することが競争優位の源泉になり得ます。

ラーゲイトが注目するのは、RAGとノーコードツールの組み合わせによる「対策の民主化」です。これまで高度なエンジニアリングが必要だったRAG環境の構築が、Difyを活用することでノーコードで実現可能となりました。さらにAmazon Bedrockとの連携によりAWS上でセキュアにホスティングすることで、セキュリティ懸念(42.2%)とハルシネーション懸念(35.2%)という、企業が抱える上位2大課題を同時に解消する道筋が生まれています。

今後の展望として、企業のAI活用は「使うかどうか」ではなく、「品質をいかに担保しながら使うか」というフェーズへ移行していくと予測されます。ハルシネーション対策を内製化できた企業とそうでない企業の間には、意思決定精度・業務品質の面で顕著な差が生まれるでしょう。

ラーゲイトでは、AWS FTR認定取得済みの専門チームが、DifyによるRAG環境構築からAWSセキュアホスティング、社内人材のリスキリングまでを一気通貫で支援しています。「RAGを導入したいが方法が分からない」「信頼性の高いAIチャットボットを社内に構築したい」といったご相談を随時承っております。

▶生成AI開発内製化支援サービス

詳細はこちら

▶ AX実現伴走支援・Dify開発支援サービス

詳細はこちら

サービス概要

- SaaS戦略とサーバーレス開発を一気通貫で提供

- 最先端AI駆動開発で迅速かつ安全なサーバーレス移行支援

- クラウドネイティブ・モダンアプリケーション開発内製化支援

- 『EOL/EOS 解消にとどまらない』業務課題起点の業務最適化&サーバーレスによる中長期コスト削減

- 最先端のAI × DXを1日で速習する生成AI実践講座

- 生成AI開発内製化と継続的リスキリング・組織定着化実現

- VMware移行とサーバーレス実装による運用効率化

企業プレスリリース詳細へ

PRTIMESトップへ