【CEATEC 2012 Vol.30】目の動きで端末を操作する「ibeam」など注目の先端技術を展示……NTTドコモ(その1)

IT・デジタル

スマートフォン

NTTドコモは、通信事業者という立場から通信ネットワークやモバイル端末の提供を行うのはもちろんのことだが、スマートフォンのUIをR&Dでも常に世界に先行して国内外のメーカーとで共同開発を行っている。各種通信技術の研究開発ばかりでなく、モバイル端末をいかに使いやすくするかといった要素技術開発にも取り組み、応用サービスを次々に生み出してきている。ここでは、NTTドコモブースで展示されている、それらの技術を紹介しつつ将来を展望してみたい。

■握り締めると端末操作ができる技術を応用した「Grip UI」

通勤電車の車内でスマートフォンを操作している際に、つり革を握っているために片手だけで操作したいというシチュエーションは多いはず。その一方で、スマートフォンのスクリーンが大型化していく昨今、片手では画面の隅まで指が届かないケースも。そんな時に役立つのではないかと思われるのが、R&Dコーナーで展示デモされている“握り締めると操作できる”技術「Grip UI」だ。

試作機では端末の左右側面にセンサーを配置し、スマートフォンを握る際の握力に応じてセンサーが反応。それにより様々な端末機能を動作させていた。同技術では力を入れる位置に応じて、端末機能を割り当てることも想定している。たとえば端末上部を握る指に力を入れると「決定」操作、端末下部を握る指に力を入れると「取消」操作という具合に操作が可能である。

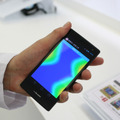

握る強さを表示してくれる確認画面では、どの指に力を入れているかをサーモグラフィで表示してくれるが、これを見ると握り締める力の入れ具合で機能を割り当てることもできそうだ。握り締めながらタッチパネル操作するというふうに、複数の操作を組み合わせることで異なる動作をさせることも可能になるのだろう。

以下は筆者の妄想だが、端末本体に圧力センサーを内蔵するというのが一般的な発想だろうが、センサー入りのスマートフォンカバーなどが登場すれば既存のスマートフォンでもこうした機能を利用できるようになるかもしれない。あるいは、握る強さの強弱を相手のスマートフォンに伝えられるようにしたら、触覚が伝えられるスマートフォンサービスというのも提供可能になるのではないだろうか。いずれにしても、応用は多岐にわたりそうな要素技術だ。

■目の動きで端末操作ができる技術を応用した「ibeam」

もう一つ、片手しか使えないシーンで役立ちそうな要素技術が展示されている。端末に内蔵された赤外線センサーで目の動きを感知し、視線で機能操作できるという技術だ。デモンストレーション用に展示された試作端末「ibeam」は、電子書籍を読むタブレット型端末を想定している。ディスプレイに表示されている電子書籍画面で、視線を動かしてページをめくったり、単語に埋め込まれている辞書を表示させたりすることが可能である。

この試作端末には、ディスプレイ下部左右に赤外線センサーが埋め込まれている。このセンサーがユーザーの視線の動きを感知し、ディスプレイ上のどの部分を見ているのかを判断。視線の動きを追うようにカーソルを移動させてくれる。また、ユーザーが1点を注視し、視線の動きが一定時間止まった場合は、その場所をタップしているのと同様の動作をするように配慮されている。ディスプレイ上に機能のボタンを配置し、そこを注視することで各種操作が可能になる。たとえば電子書籍画面で、画面左下部分を注視するとページめくりでき、また本文中にタグが埋め込まれた単語部分を注視すれば、その単語の解釈が表示されるといった具合だ。また、タッチパネル操作と目線での操作の組み合わせで操作することも可能となっている。たとえばWebブラウジング画面で、拡大して表示したい場所を注視し、端末を握る指を上下させることで、ブラウジング画面の拡大縮小操作ができるようになっている。

視線での操作にあたっては、ユーザーごとにキャリブレーションの実施が必要であったり、端末と目との距離や位置関係をある程度一定に保つ必要があるなど、実用性面での改善も必要になろうが、これも近未来には端末に実装されてきそうな要素技術といえそうだ。何より、身体が不自由なユーザーでも操作ができるようになるなど、新たなユーザー層での利活用の可能性も拡がってくる。

■メガネ型端末が実現された際のテレビ電話はこうなる

近未来型のモバイルデバイスとしてシースルー型ヘッドマウントディスプレイが話題になってきたが、未来のモバイル端末の形状のひとつとして「メガネ型」が登場してもおかしくはないだろう。さらには、メガネ型端末でTV電話(ビジュアル通話)を実現させるための技術も必要になってくるかもしれない。

NTTドコモでは、こうした近未来のニーズを実現させるための技術開発事例として、メガネに計5個の超広角カメラを内蔵させ、メガネをかけるだけであたかも目の前にTV電話用のカメラが置かれているような映像を通話先に送ることができる「ハンズフリービジュアルホン」を参考出品している。

現時点では、顔の一部の映像をあらかじめ取り込み、表情を表現する目尻周辺の映像を合成して擬似的な顔表示を実現させたものとなっている。超広角カメラで撮影した時点での顔の映像は歪んでいるが、カメラと撮影された顔の部位との位置関係から画像補正を行い、また複数のカメラで捉えた顔画像を1つの表情に合成して、擬似的な顔を投影できるようにしている。一見、CG画像のようにも見えるが、実際の顔の表情をカメラで捉えているため、目の動きなどは実際の顔と同様に表示されている。メガネ内にはモーションセンサーも搭載されているようで、顔の傾きや動きも表現可能だ。音声に合わせて口も動く。また、背面にもカメラを設置し、背景に拡がる風景も現実の風景を捉えている。従って、TV電話中に背景のカーテンを閉めれば、そのカーテンが映像背景にそのまま映し出される。

以上、今回のCEATEC JAPAN 2012におけるNTTドコモブースの展示の中で、近未来に実現しそうな要素技術展示部分をご紹介した。こうした要素技術はNTTドコモの研究開発部門が担っており多様な研究開発が行われている。毎年様々な技術が展示されるのだが、今回の展示で紹介されたものは、スマートフォンやスマートタブレット、さらにメガネ型モバイルデバイスなど、昨今のモバイル端末の変化とその利活用シーンを想定し、操作性を向上させるためにどんな技術を応用できるかを分かりやす形で示してくれた事例といえそう。しかも、どの技術も比較的近い将来には製品化されそうな身近な技術と感じた。スマートフォンと家電が連携すると、どのような未来が実現できるのかを紹介したい。

![[docomo Wi-Fi] 北海道のPRONTO IL BAR 日本生命札幌ビル店など約17,900か所で新たにサービスを開始 画像](/imgs/square_medium_large/224172.jpg)